论文阅读《LingBot-World:推进开源世界模型》

0. 论文基本信息

- 标题:LingBot-World: Advancing Open-source World Models

- 作者/机构:Robbyant Team,Ant Group(蚂蚁集团)

- 发表出处/时间:技术报告,网站与代码仓库已于2026年1月前公开发布(GitHub: https://github.com/robbyant/lingbot-world)

1. 核心问题与创新总览

该研究聚焦于“世界模型 (World Model)”从传统“文本到视频 (Text-to-Video)”生成迈向“文本到世界 (Text-to-World)”交互式仿真的关键鸿沟:现有高质量视频生成模型虽然能合成短时、视觉一致的片段,但往往更像“做梦者 (Dreamer)”而非“模拟器 (Simulator)”,缺乏对因果性、物体恒常性以及交互后果的稳定建模,从而难以在分钟级时长内维持结构与叙事一致,更难以在低时延下支持实时控制。与此同时,交互数据稀缺、扩散采样昂贵、以及最先进系统闭源等现实因素进一步限制了社区研究与应用落地。

为此,作者提出并开源 LingBot-World:一个从视频生成出发、面向交互世界仿真的整体框架与系统。其最本质的创新思路在于:以“可规模化的数据引擎 + 分阶段演化训练管线”将强视频先验逐步“进化”为可控、长时一致、并能实时推理的交互式世界模拟器;其中数据侧通过“分层语义标注 (Hierarchical Captioning)”解耦静态场景与动作/运动控制,模型侧通过“混合专家 (Mixture-of-Experts, MoE)”与“因果化 (Causal)”改造及“少步蒸馏 (Few-step Distillation)”将双向扩散教师转为可流式自回归推理的学生,实现低于 1 秒时延、16 fps 交互生成,并展示分钟级乃至 10 分钟级长程一致性与“长期记忆 (Long-term Memory)”涌现能力。

2. 背景与研究动机

在该工作之前,主流生成式视频方法通常以“扩散模型 (Diffusion Model)”为核心,擅长从文本或图像条件生成高保真短视频。然而,当目标从“离线渲染短片段”转向“可交互、可持续、逻辑一致的世界仿真”时,既有范式暴露出多重瓶颈:其一,高质量交互数据难以规模化采集,尤其需要动作信号与环境反馈严格对齐;其二,标准扩散架构在长序列上容易出现灾难性遗忘 (Catastrophic Forgetting),难以在分钟级轨迹上保持场景结构一致;其三,扩散采样多步迭代导致推理计算量高,使实时控制不可行;此外,领先系统多为闭源,形成开放研究与工程实践的能力断层。

作者的关键观察与直觉包括:

- 仅依赖网络视频的被动数据难以学习“动作—状态转移”的可控动力学;必须引入游戏/引擎数据,并补齐相机位姿等几何信息。

- “长程一致性”并非单一技巧可得,需要在训练分布、序列长度与噪声时间步分配上系统性地偏向全局结构建模。

- 若要实现实时交互,必须将教师式双向扩散模型改造成满足严格因果约束的流式生成结构,并用蒸馏与长程自回放训练缓解推理时分布漂移。

3. 方法论深度解构 (Methodology)

3.1 整体架构:从数据到世界仿真的端到端系统

LingBot-World 由三大层级协同构成: (A) 数据引擎 (Data Engine):负责多源采集、剖析与分层标注,输出带动作/相机/文本条件的训练样本; (B) 分阶段演化训练 (Multi-stage Evolutionary Training):将强视频先验逐步转化为可控长程世界模型,并进一步优化到实时; (C) 应用侧能力:在可交互生成之上,支持可提示世界事件、动作智能体训练与 3D 重建验证。

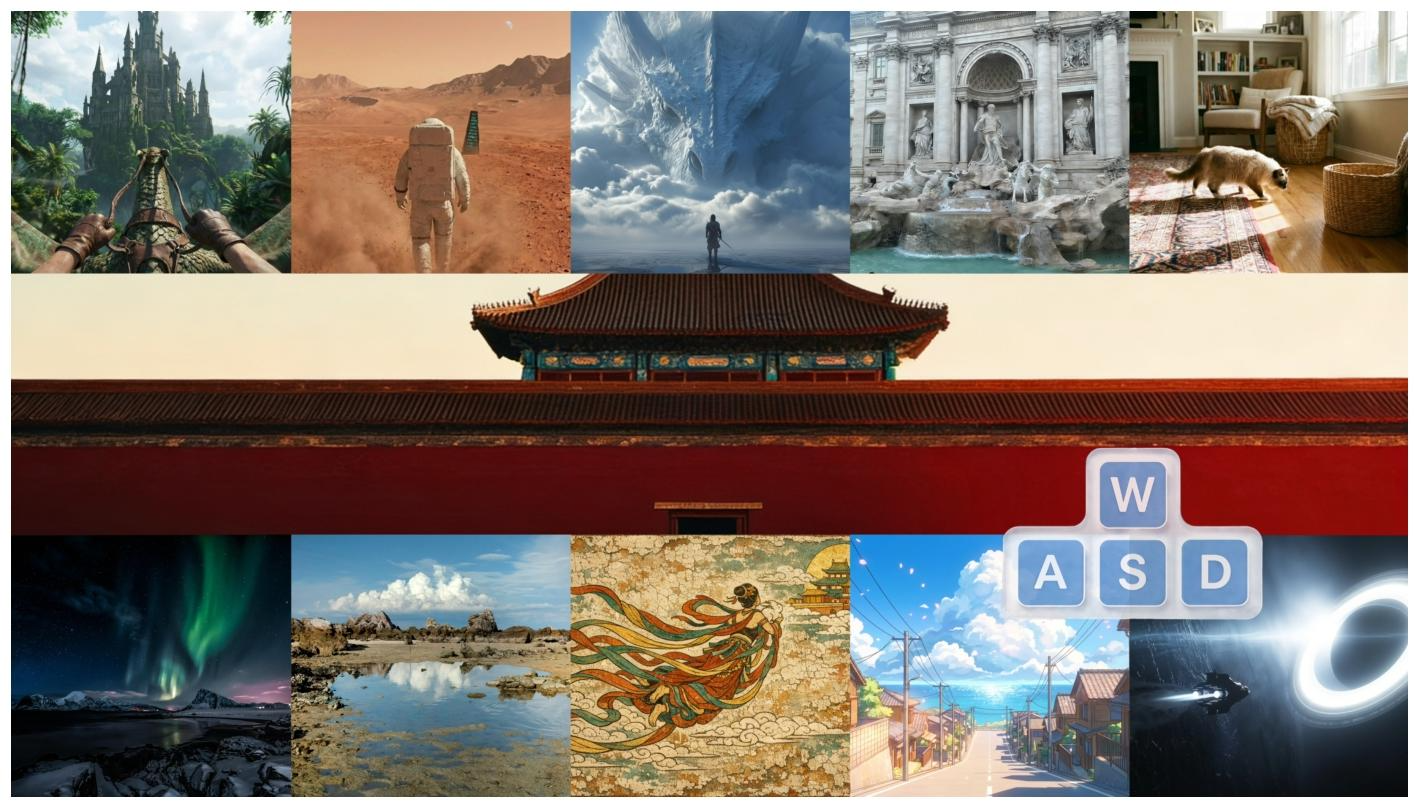

图1展示 LingBot-World 在写实、科学可视化、卡通/风格化等多环境中的交互生成结果;画面叠加的 W/A/S/D 键位图标表明生成过程可被离散动作控制驱动,体现“可控动力学 + 视觉高保真”的统一目标。该图隐含的数据流是:用户动作输入 → 模型状态转移 → 连续视频帧输出;其核心评估维度包括保真度、动态程度与跨时间一致性。

3.2 数据引擎 (Data Engine):为世界模型构建可控、可扩展训练分布

作者将数据引擎组织为统一管线,包含三部分:数据采集 (Data Acquisition)、数据剖析 (Data Profiling)、数据标注 (Data Captioning)。其目的并非仅扩大数据规模,而是为“动作可控、长程一致”的学习目标构造结构化监督信号。

3.2.1 数据采集:通用视频 + 游戏交互 + Unreal Engine 合成

数据采集采用混合策略:

- 通用高质量视频:覆盖第一/第三人称、人类/动物/车辆等多样内容,以拓展开放域视觉与运动模式。

- 游戏数据:关键在于 RGB 帧与用户控制输入(如 W/A/S/D)及相机参数严格配对,实现动作—观测的时序对齐。

- Unreal Engine (UE) 合成渲染:生成可控相机轨迹并导出真实相机内外参,提供高精度几何监督与多样化轨迹(尤其是反复回看与重访路径),用于强化空间记忆。

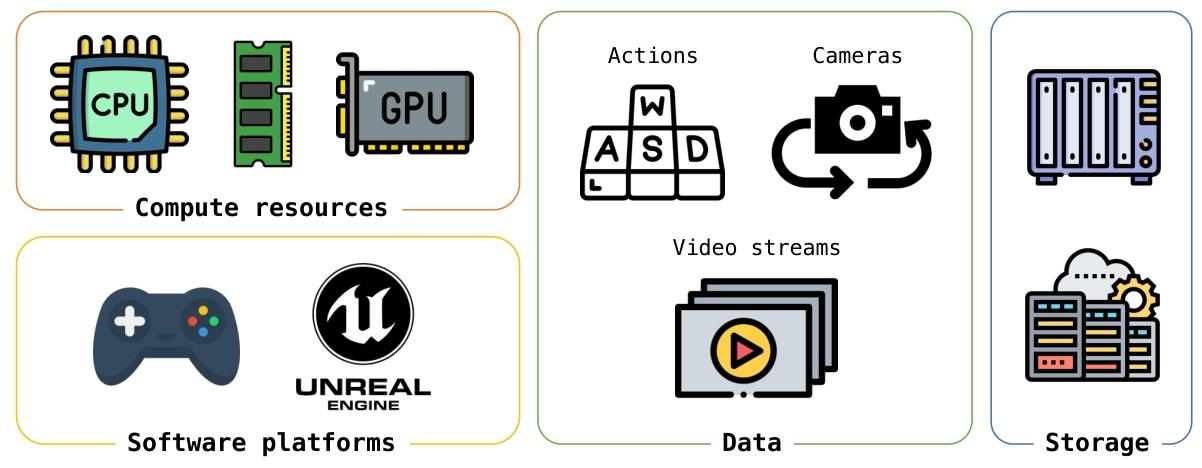

图2以“计算资源/软件平台 → 视频流 → 数据存储”为主线,并强调动作信号与相机状态与视频帧的时间对齐:动作与相机作为控制变量,视频流作为观测变量,最终形成可用于学习条件转移的三元组序列。

图2以“计算资源/软件平台 → 视频流 → 数据存储”为主线,并强调动作信号与相机状态与视频帧的时间对齐:动作与相机作为控制变量,视频流作为观测变量,最终形成可用于学习条件转移的三元组序列。

作者进一步将游戏采集分为导航、观光、长尾场景与世界交互四类,以覆盖从自由探索到物体交互/破坏等因果关系数据;UE 侧轨迹生成包含“程序化路径生成”与“真实轨迹导入”,分别在随机性与行为真实性之间权衡。

3.2.2 数据剖析:过滤、切分、语义评估与几何补全

多源数据存在分辨率、时长、相机信息缺失等异质性。数据剖析作为标准化层,分三层粒度:

- 基础过滤与时间切分:基于分辨率/时长等筛除低质样本,并用 Koala 与 TransNet v2 等算法切分为训练片段以保持语义一致。

- 语义分析:使用视觉语言模型 (Vision-Language Model, VLM) 评估亮度/清晰度、运动幅度、视角类型等属性,为下游筛选提供量化依据。

- 几何标注:对缺失相机信息的视频,使用位姿估计生成内外参伪标签,并利用 MegaSAM 等生成相机位姿注释以补齐 3D 结构先验。

图3将原始数据流转为最终训练数据:原始视频 → 过滤/切分 → 属性抽取与语义筛选 → 几何标注 → 分层文本标注(叙事/静态/时间密集)。该图表达的关键逻辑是:先保证“物理可用性”(分辨率、时长、片段一致),再保证“语义可控性”(VLM 属性),最后保证“条件可对齐性”(相机几何与动作),以支撑世界模型学习。

图3将原始数据流转为最终训练数据:原始视频 → 过滤/切分 → 属性抽取与语义筛选 → 几何标注 → 分层文本标注(叙事/静态/时间密集)。该图表达的关键逻辑是:先保证“物理可用性”(分辨率、时长、片段一致),再保证“语义可控性”(VLM 属性),最后保证“条件可对齐性”(相机几何与动作),以支撑世界模型学习。

3.2.3 分层语义标注:用三层文本条件解耦“静态世界”与“动作驱动变化”

作者提出三类互补 caption:

- 综合叙事描述 (Narrative Caption):包含环境、相机轨迹与时间演化,作为全局语义提示;

- 场景静态描述 (Scene-static Caption):刻意省略相机运动与动作,仅描述环境与美学细节,用于将“场景生成”与“运动控制”解耦;

- 时间密集描述 (Dense Temporal Caption):将视频分段并给出时间对齐事件描述,支持时间对齐训练与细粒度动态学习。

该设计的关键在于:世界模型训练时若将动作与场景内容混合进单一文本条件,容易导致模型把“动作信号”误当作“静态纹理/语义”来记忆;通过 scene-static caption 固定环境语义,通过 temporal caption 强调事件演化,使动作控制更可能映射到动力学变化而非场景外观漂移。

3.3 世界模型形式化:从条件生成到交互状态转移

作者将世界模型视为在动作驱动下的条件生成过程。设视频帧序列为

动作序列为

目标是学习参数化模型 逼近环境转移动力学,最大化“给定历史与动作条件下未来片段”的对数似然期望:

其中 为预测视野。该形式化并不把世界模型限定为一步预测,而允许生成长度为 的未来窗口;在训练管线中,通过不同阶段对 的选择与注意力结构的改变,实现从“双向建模”到“因果滚动”的范式切换。

3.4 分阶段演化训练:从视频先验到实时交互模拟

作者提出三阶段:预训练 (Pre-Training)、中训练 (Middle-Training)、后训练 (Post-Training)。其核心思想是先获得强视频纹理与时空一致性先验,再注入交互控制与长程一致性,最后为实时推理进行结构因果化与少步蒸馏。

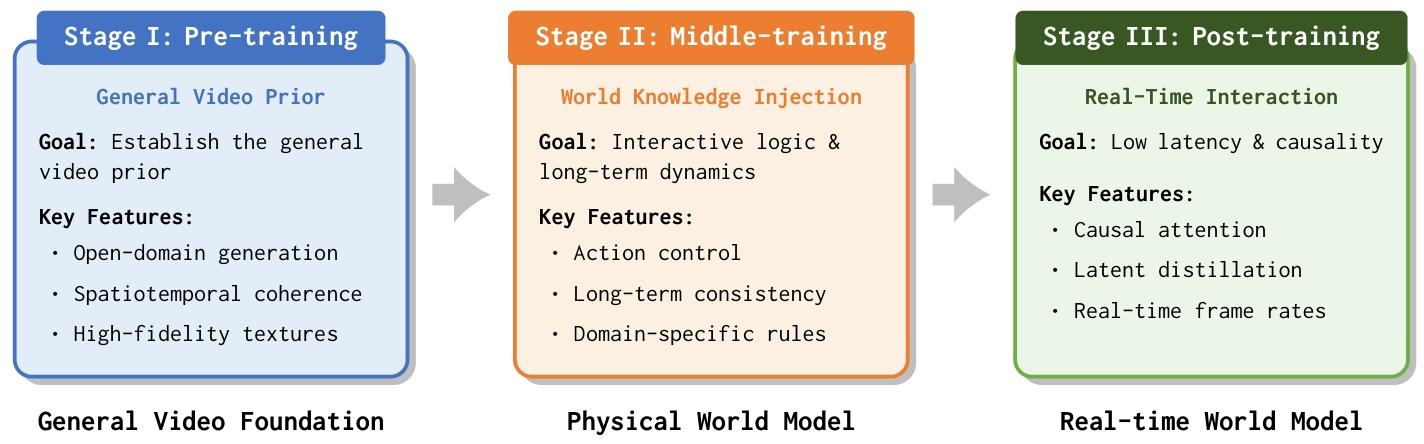

图4以“通用视频基础 → 物理世界模型 → 实时世界模型”为主线:阶段 I 强调开放域与高保真纹理;阶段 II 强调动作控制与长程一致;阶段 III 强调因果性、低时延与实时帧率。该图同时表达了训练目标的迁移:从“生成质量”逐步转为“交互可用性”。

图4以“通用视频基础 → 物理世界模型 → 实时世界模型”为主线:阶段 I 强调开放域与高保真纹理;阶段 II 强调动作控制与长程一致;阶段 III 强调因果性、低时延与实时帧率。该图同时表达了训练目标的迁移:从“生成质量”逐步转为“交互可用性”。

3.4.1 阶段 I:预训练——建立通用视频先验

阶段 I 的目标是获得一个具备强时空一致性与开放域语义理解的视频生成器作为初始化,使后续训练不必从零学习纹理、物体外观与基础运动规律。作者选择 Wan2.2 图像到视频扩散模型 (Wan2.2 Image-to-Video Diffusion Model) 作为 14B 参数的预训练基座。该选择的理由是其在复杂时空一致性与高保真视频生成方面表现强,为“交互动力学”提供视觉画布。

3.4.2 阶段 II:中训练——注入世界知识、长程一致与动作可控

阶段 II 将预训练生成器提升为“双向世界模型 (Bidirectional World Model)”。在式 (1) 中取 对齐双向范式,使模型可利用全局时间依赖学习长程一致性,而暂不受因果约束限制。该阶段关键改造包括:长序列训练以缓解遗忘、将动作信号注入网络以实现可控转移、以及通过并行训练基础设施承载 28B 规模与分钟级序列长度。

(a) 基础世界模型:MoE + 课程学习 + 多任务初始条件

混合专家 (Mixture-of-Experts, MoE):模型采用两专家结构以匹配扩散去噪过程:

- 高噪专家 (High-noise Expert):在早期时间步激活,负责全局结构与粗布局;

- 低噪专家 (Low-noise Expert):在后期时间步激活,负责细节与高频时空精修。 每个专家约 14B 参数,总规模约 28B,但每个去噪时间步仅激活一个专家,使推理成本接近稠密 14B 模型。

渐进课程学习 (Progressive Curriculum Training):训练序列长度由 5 秒逐步扩展至 60 秒,以逐渐学习长程一致与空间记忆;同时“逐步增大 flow shift 并提高高噪时间步占比”,其动机是长视频更依赖高噪阶段对全局结构的建模能力,提升高噪比例可稳定场景级结构,减少漂移。

多任务训练 (Multi-task Training):同时优化“图像到视频 (Image-to-Video)”与“视频到视频续写 (Video-to-Video / Video Continuation)”目标,以支持任意初始条件:单帧推演未来与基于历史续写未来共同约束出统一的世界转移函数。

(b) 动作条件世界模型:动作表示 + AdaLN 注入 + 参数高效微调

动作表示 (Action Representation) 采用混合方式:

- 连续相机旋转用 普吕克嵌入 (Plücker Embedding) 表示,以支持连续 3D 变换;

- 离散键盘动作用多热向量 (Multi-hot Vector) 表示; 二者在通道维拼接融合。该设计覆盖“平滑视角变化”与“离散逻辑状态转移”。

动作注入机制 (Action Injection Mechanism):使用 自适应层归一化 (Adaptive Layer Normalization, AdaLN) 将融合后的动作嵌入投影后注入到 DiT 模块,使动作通过 scale/shift 调制归一化后的特征,从而在不破坏预训练视觉先验的前提下引导去噪生成符合动作的帧序列。

微调范式 (Finetuning Paradigm):冻结主干 DiT 模块,仅训练新增动作适配层(动作投影与 AdaLN 参数),实现参数高效微调。其动机是动作标注数据相对稀缺且可能偏合成分布,若全量微调易导致灾难性遗忘或画质退化;冻结主干可保留高保真生成能力,同时学习动作跟随。

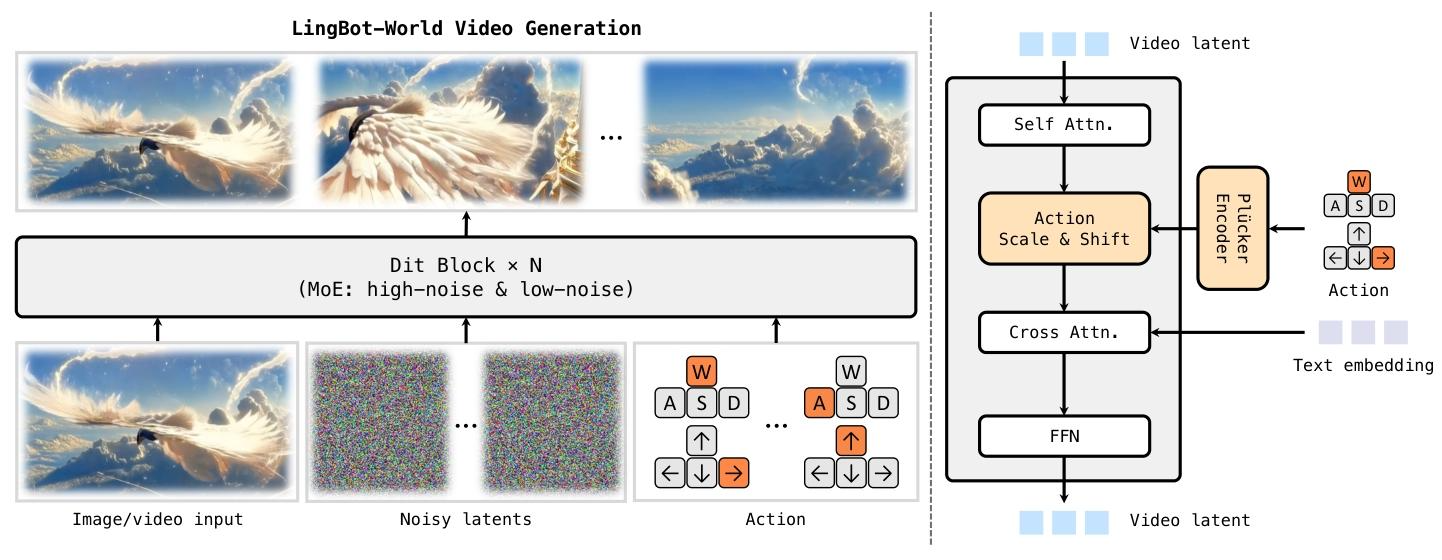

图5左侧描述输入—输出:初始图像/视频条件 + 噪声潜变量 (Noisy Latents) + 用户动作信号 → 输出具备空间记忆与长程一致的视频序列。右侧展开 DiT 模块:潜变量先经自注意力 (Self Attention) 学习时空一致与空间记忆;动作通过 Plücker 编码器生成动作嵌入,并经 AdaLN 转成 scale/shift 调制主干特征;随后通过交叉注意力 (Cross Attention) 结合文本嵌入实现文本条件控制。该图的关键是动作调制发生在特征归一化处,使动作能稳定影响动力学而不直接扰动像素纹理先验。

图5左侧描述输入—输出:初始图像/视频条件 + 噪声潜变量 (Noisy Latents) + 用户动作信号 → 输出具备空间记忆与长程一致的视频序列。右侧展开 DiT 模块:潜变量先经自注意力 (Self Attention) 学习时空一致与空间记忆;动作通过 Plücker 编码器生成动作嵌入,并经 AdaLN 转成 scale/shift 调制主干特征;随后通过交叉注意力 (Cross Attention) 结合文本嵌入实现文本条件控制。该图的关键是动作调制发生在特征归一化处,使动作能稳定影响动力学而不直接扰动像素纹理先验。

(c) 并行训练基础设施:FSDP2 + Context Parallel

面对 28B 参数与分钟级序列的显存压力,作者引入两类并行:

- 全分片数据并行 2 (Fully Sharded Data Parallel 2, FSDP2):参数、梯度与优化器状态全分片,单卡仅持有分片,支撑超大模型训练,并通过通信与计算重叠实现吞吐扩展。

- 上下文并行 (Context Parallel, CP):采用 Ulysses 将序列维切分到多卡,通过高效 all-to-all 交换完成注意力计算所需激活重分布,从而显著降低每卡激活与注意力中间量的内存占用,允许长序列并行处理。

3.4.3 阶段 III:后训练——因果化改造与少步蒸馏实现实时交互

阶段 II 的双向扩散模型虽能准确刻画动力学,但其全时序注意力与多步去噪使实时部署成本过高。阶段 III 的目标是将其转化为严格因果、可流式生成的自回归系统,并通过蒸馏将采样步数压缩到少步,同时抑制长程滚动的误差累积与漂移。

(a) 因果结构改造:块因果注意力 + 扩散强制

初始化策略:教师为两专家 MoE 扩散模型。学生因果生成器用 高噪专家初始化,理由是其更擅长动力学建模;实验上该初始化优于低噪专家。

块因果注意力 (Block Causal Attention):用“块内双向 + 块间因果”的混合掩码替代全双向时序注意力:

- 在每个时间块 (Chunk) 内允许双向注意力以捕获局部依赖并维持邻近帧一致;

- 在块之间施加因果约束:当前块只能关注历史块与自身块,禁止访问未来块,从而允许无界自回归滚动。

推理时,因果结构支持 键值缓存 (KV Caching):历史块的表示可缓存,仅对新增块计算注意力,大幅降低逐步生成开销。

训练协议与损失:序列被切成 个块,每块分配独立噪声时间步,遵循 扩散强制 (Diffusion Forcing)。为控制计算成本,训练仅选取有限目标时间步集合 作为蒸馏目标;由于学生从高噪专家初始化(偏高噪条件),训练加入 的干净监督以弥合教师高噪/低噪专家分工差距。其损失为:

其中 为学生网络, 为视频数据分布, 为动作条件。该目标的直觉是:在若干关键噪声层级上,让学生在动作条件下把噪声潜变量映射回对应的干净潜变量,从而为少步推理奠定可学习的去噪轨迹。

图6(a)展示块因果注意力下的生成器:输入为图像/视频条件、文本嵌入、动作序列与噪声潜变量;输出为视频潜变量序列,采用 KV 缓存以流式生成。图6(b)展示为长程蒸馏附加的判别器头 :在假分数网络特征上加 GAN 分类头,并用交叉注意力区分真实与合成序列,用于缓解长程滚动的累积漂移。

图6(a)展示块因果注意力下的生成器:输入为图像/视频条件、文本嵌入、动作序列与噪声潜变量;输出为视频潜变量序列,采用 KV 缓存以流式生成。图6(b)展示为长程蒸馏附加的判别器头 :在假分数网络特征上加 GAN 分类头,并用交叉注意力区分真实与合成序列,用于缓解长程滚动的累积漂移。

(b) 少步蒸馏与长程训练:自回放 + DMD + 对抗优化

作者指出:即便完成因果改造,若训练主要基于真实数据短视野,推理时自回归滚动会产生训练—测试分布差异,导致超过训练视野后漂移累积。因此引入两类机制:

自回放长视野训练 (Self-rollout Extended Horizon Training):遵循 自强制 (Self Forcing) 思路,用学生自身生成的帧作为后续条件,迫使模型学习从自身误差中恢复;通过滚动 KV 缓存保存已生成帧,并采用“随机梯度截断”:仅在最近 步反传梯度,但前向仍保留全上下文,以平衡效率与长依赖学习。

分布匹配蒸馏 (Distribution Matching Distillation, DMD):以中训练 MoE 教师作为真实分数 (Real Score) 近似,构建假分数网络 (Fake Score Network) 追踪学生分布。对动作条件生成,作者给出关于学生参数 的 KL 梯度形式:

其中 为学生在时间步 的分布, 为数据分布, 为学生生成的干净样本, 为其前向扩散得到的噪声版本, 为动作条件, 分别为真实/假分数近似。

作者将其转化为可优化目标:

其中 为参数 的假分数网络, 为停止梯度算子。训练时用“两时间尺度更新规则”:每次更新学生前,对 做多次更新以跟踪学生分布,从而提升稳定性。

对抗优化 (Adversarial Optimization):作者指出 DMD 后学生仍与教师存在质量差距,原因包括:学生初始化自高噪专家无法继承低噪专家精细细节能力;注意力掩码变为因果且推理步数减少;且 DMD 过程中生成器与教师都不直接受真实数据监督,可能继承教师偏差。为引入真实数据监督,作者在 DMD 的假分数网络上附加 GAN 判别头 (结构参考 APT),并采用 softplus 形式对抗目标:

其中 与 分别为真实与合成视频分布, 为自回放中的当前去噪时间步, 为 softplus。作者强调:对抗损失仅用于更新判别头 ,假分数网络仍仅用 DMD 损失更新;并且不使用 R1/R2 正则。该组合旨在提高视觉真实感、同时保持动作跟随与长程一致性。

4. 实验设置与结果分析

4.1 实验环境:数据、指标与对比对象

数据来源:作者的数据引擎整合通用视频、游戏交互数据与 UE 合成渲染数据,且包含分层 caption 与相机几何信息。

对比模型:在交互世界模型对比中,表1对照了 Matrix-Game 2.0、Yume-1.5、HY-World 1.5、Mirage 2、Genie 3 与本文方法;作者强调 LingBot-World 在“通用域 + 长生成视野 + 高动态程度 + 实时 + 全开源”的组合上具有区分性。

评价指标:量化评测采用 VBench (VBench),并在包含 100 个生成视频(每个超过 30 秒)的测试集上评估多个维度:成像质量、美学质量、动态程度、运动平滑、时间闪烁与总体一致性。

4.2 主实验结果:质化能力、长程记忆与量化指标

4.2.1 质化结果:Base 与 Fast 变体的视觉与动力学表现

作者分别展示中训练模型 LingBot-World-Base 与后训练实时模型 LingBot-World-Fast 的关键帧序列。结论要点包括:Base 版本在多样对象属性与复杂空间结构中保持帧间平滑且逻辑一致;Fast 版本在实现实时吞吐的同时,感知层面的质量退化较小,并保持教师模型的结构完整与物理逻辑,未出现明显伪影或模式崩塌。

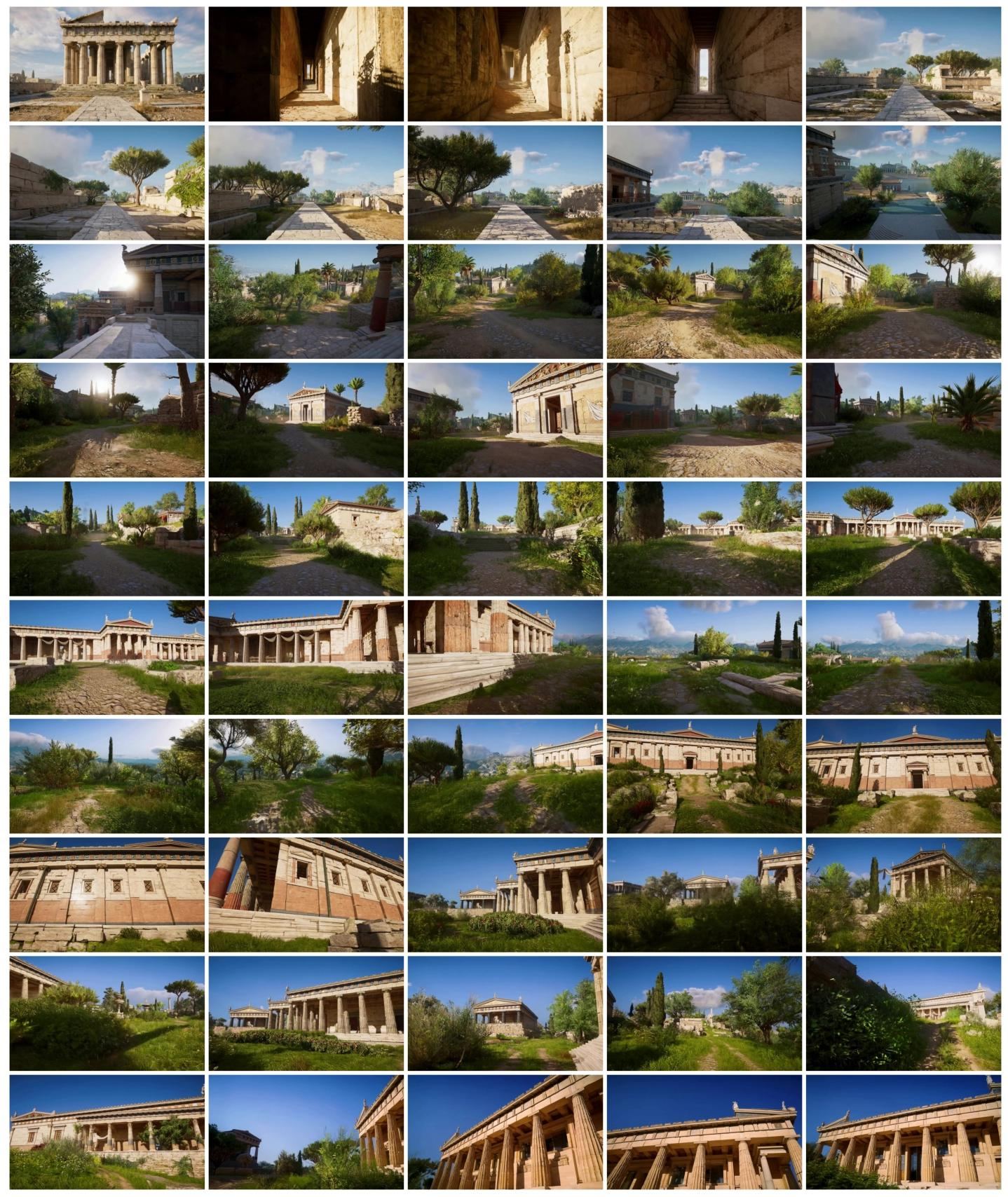

图7以多行关键帧展示随时间推进的场景演化:每行对应一个场景,列方向对应时间采样点;可从纹理细节的稳定、远近景结构的延续、以及运动方向一致性观察其时空连贯性。

图7以多行关键帧展示随时间推进的场景演化:每行对应一个场景,列方向对应时间采样点;可从纹理细节的稳定、远近景结构的延续、以及运动方向一致性观察其时空连贯性。

图10强调 Fast 在加速后仍能维持大结构一致:同一场景内地形轮廓、地平线与主要物体布局随动作推进呈一致的几何变化,体现“速度—质量”权衡下的可用性。

图10强调 Fast 在加速后仍能维持大结构一致:同一场景内地形轮廓、地平线与主要物体布局随动作推进呈一致的几何变化,体现“速度—质量”权衡下的可用性。

此外,作者给出系统性能描述:Fast 版本在 480p 分辨率、单 GPU 节点条件下实现 16 fps 的吞吐;并在摘要层面宣称交互生成 16 fps 时延低于 1 秒。

4.2.2 涌现记忆能力:60 秒遮挡后地标一致与“未观测状态”推理

作者强调 LingBot-World 的“记忆”并非显式 3D 表示(如 Gaussian Splatting),而是在长上下文训练中涌现的全局一致性能力:地标在离开视野 60 秒后仍保持结构完整;并且模型能对未观测区域的状态演化作出一致推断(例如相机前进后回到正前方,远处桥梁应更近;车辆离开画面后仍沿道路前行并在合理位置再出现)。

图12按行展示两类现象:前若干行是静态地标在长时间不可见后的结构一致(对应“物体恒常性”与场景结构保持);后两行展示未观测状态推断:相机运动导致远处结构尺度变化符合透视与位移直觉;运动体在遮挡期间仍持续运动,回归视野时位置合理。该图的逻辑关键在于:生成结果体现的不仅是像素延续,而是与动作驱动的世界状态转移一致的空间—时间推断。

图12按行展示两类现象:前若干行是静态地标在长时间不可见后的结构一致(对应“物体恒常性”与场景结构保持);后两行展示未观测状态推断:相机运动导致远处结构尺度变化符合透视与位移直觉;运动体在遮挡期间仍持续运动,回归视野时位置合理。该图的逻辑关键在于:生成结果体现的不仅是像素延续,而是与动作驱动的世界状态转移一致的空间—时间推断。

4.2.3 超长生成边界:10 分钟视频一致性

作者展示模型可生成最长达 10 分钟的连贯视频,且在较长时长内维持环境稳定与叙事一致,作为长程依赖处理能力的证据。

图13以密集关键帧网格表达长时生成:若干列对应时间推进,多个场景展示在长跨度下仍维持同一地貌/建筑语义与整体结构稳定;该图强调的是“长期一致性”而非短时局部平滑。

图13以密集关键帧网格表达长时生成:若干列对应时间推进,多个场景展示在长跨度下仍维持同一地貌/建筑语义与整体结构稳定;该图强调的是“长期一致性”而非短时局部平滑。

4.2.4 量化对比:VBench 上动态程度与一致性优势

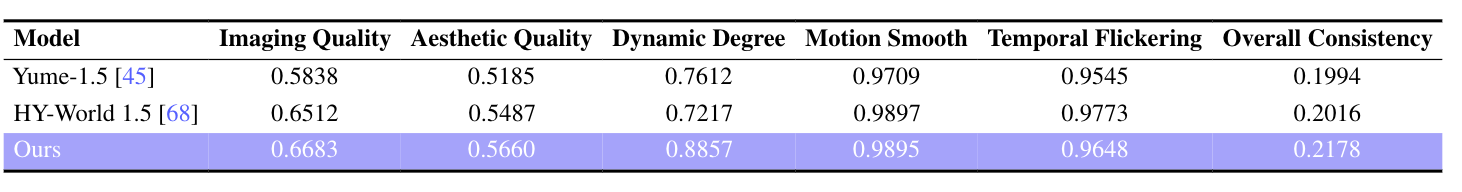

作者在 VBench 上与 Yume-1.5、HY-World 1.5对比(表2)。核心结论:本文方法在“成像质量 (Imaging Quality)”与“美学质量 (Aesthetic Quality)”上得分最高;在交互世界模型关键指标“动态程度 (Dynamic Degree)”上显著领先(0.8857 vs 0.7612/0.7217);在“总体一致性 (Overall Consistency)”上也最好;在“运动平滑 (Motion Smoothness)”与“时间闪烁 (Temporal Flickering)”上与领先基线接近,保证流畅性与低伪影。

该表可按列理解:视觉质量(成像/美学)衡量逼真度与观感;动态程度衡量对动作控制下丰富运动与场景变化的响应;运动平滑与时间闪烁衡量时间连续性;总体一致性衡量长序列语义与结构保持。表中数值体现本文方法在动态响应提升的同时未显著牺牲时间稳定性,并在一致性维度取得优势。

该表可按列理解:视觉质量(成像/美学)衡量逼真度与观感;动态程度衡量对动作控制下丰富运动与场景变化的响应;运动平滑与时间闪烁衡量时间连续性;总体一致性衡量长序列语义与结构保持。表中数值体现本文方法在动态响应提升的同时未显著牺牲时间稳定性,并在一致性维度取得优势。

4.3 消融实验 (Ablation Study)

论文在当前文本中未给出标准“去掉模块并报告数值变化”的消融表,但在方法叙述中明确指出多个组件的必要性与动机:

- 长视频课程学习与提高高噪时间步占比用于减少长程漂移、稳定全局结构;

- 冻结主干、仅微调动作适配层用于避免动作数据分布导致的灾难性遗忘与画质退化;

- 因果块注意力与 KV 缓存用于实现流式自回归与实时开销降低;

- 自回放训练与 DMD+对抗目标用于缓解推理分布漂移与提升少步生成质量。

5. 结论与展望

5.1 作者总结

作者将 LingBot-World 总结为一个覆盖“数据—建模—实时推理—应用验证”的开源世界模型框架:数据侧提供可扩展自动采集与分层语义标注以构造高质量训练分布;建模侧提出面向动作控制的因果 Transformer 架构,并用实时蒸馏实现高效推理;应用侧展示可提示事件、动作智能体与 3D 重建,验证模型的交互性与几何一致性。

5.2 局限性

作者明确列出若干限制:

- 记忆稳定性:当前“记忆”主要来自上下文窗口的涌现能力而非显式存储模块,因此稳定性不足,长程模拟易出现不一致。

- 计算成本:推理成本仍高,需要企业级 GPU,难以在消费级硬件运行。

- 动作空间受限:主要处理导航与基础移动,复杂交互不足。

- 交互精度不足:缺乏精确目标级 grounding,难以在杂乱场景中对特定物体进行精细操作。

- 生成长度与漂移:随视频长度增长会出现结构漂移,连贯长度仍不足以支撑长时间游戏。

- 单智能体视角:暂不支持多智能体交互。

5.3 未来工作

作者提出下一步将:

- 显著扩展动作空间并增强“物理引擎”能力,使交互更丰富、更真实;

- 设计更好的显式记忆模块 (Explicit Memory Module),替代仅依赖涌现记忆的方式以提升长程稳定性;

- 重点解决长时生成中的漂移问题,以实现更长甚至无限时间的可玩交互模拟。